Experiencia háptico-virtual multimodal inmersiva

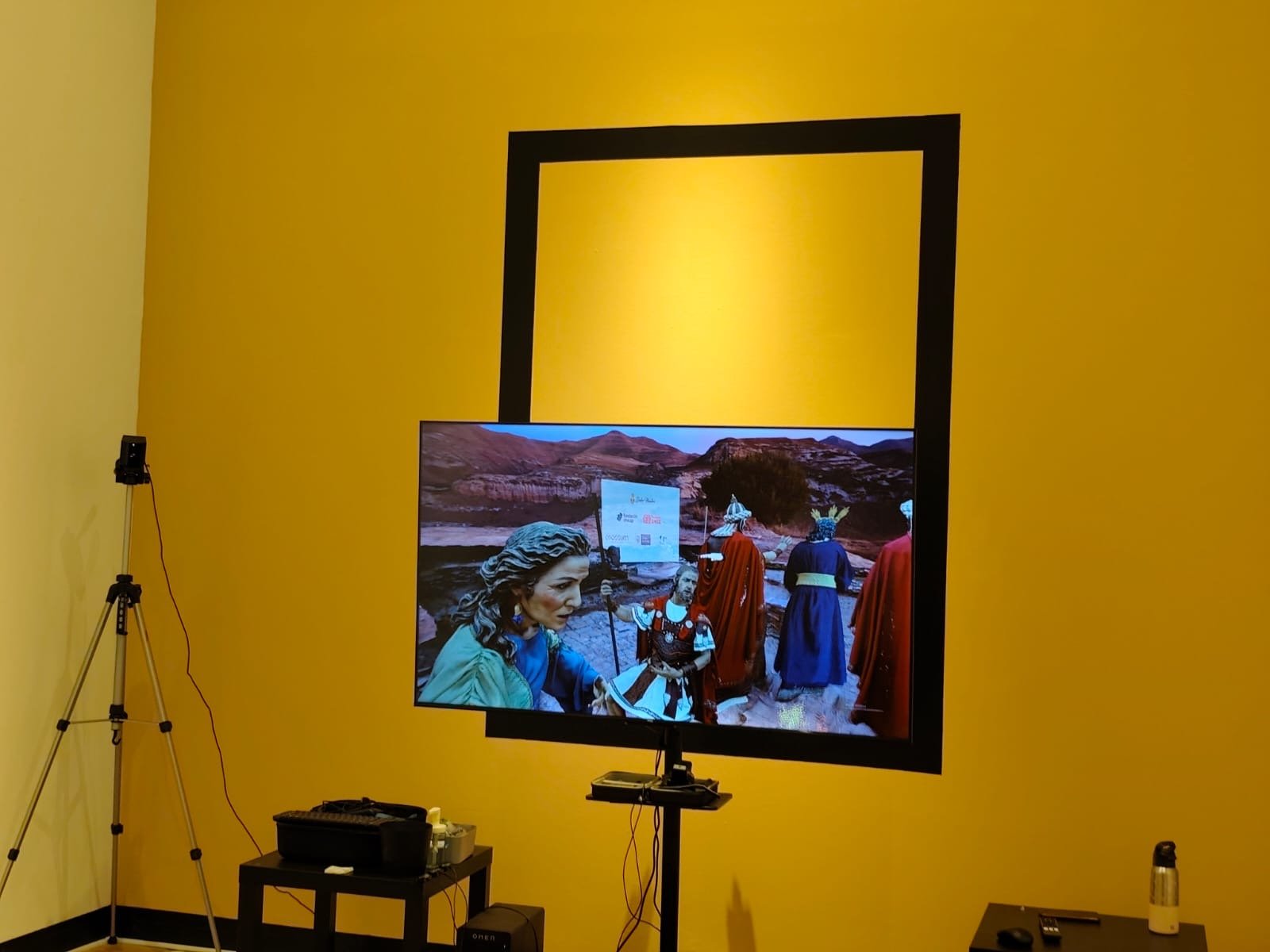

La experiencia inmersiva háptico-virtual multimodal ChivataLab, que forma parte de la exposición de Negaciones 4.0: una muestra para los sentidos constituye el núcleo tecnológico y sensorial del proyecto, un espacio de investigación aplicada donde el patrimonio procesional andaluz se reinterpreta desde los lenguajes de la accesibilidad universal, la museografía inclusiva y las humanidades digitales (narrativas curatoriales postdigitales). Concebida bajo los principios de accesibilidad originaria, es decir, como núcleo principal de la propuesta, elimina las jerarquías entre público vidente, ciego, sordo o con diversidad cognitiva, permitiendo que todas las personas puedan experimentar la escena de Las Negaciones y Lágrimas de San Pedro desde una misma condición perceptiva y emocional.

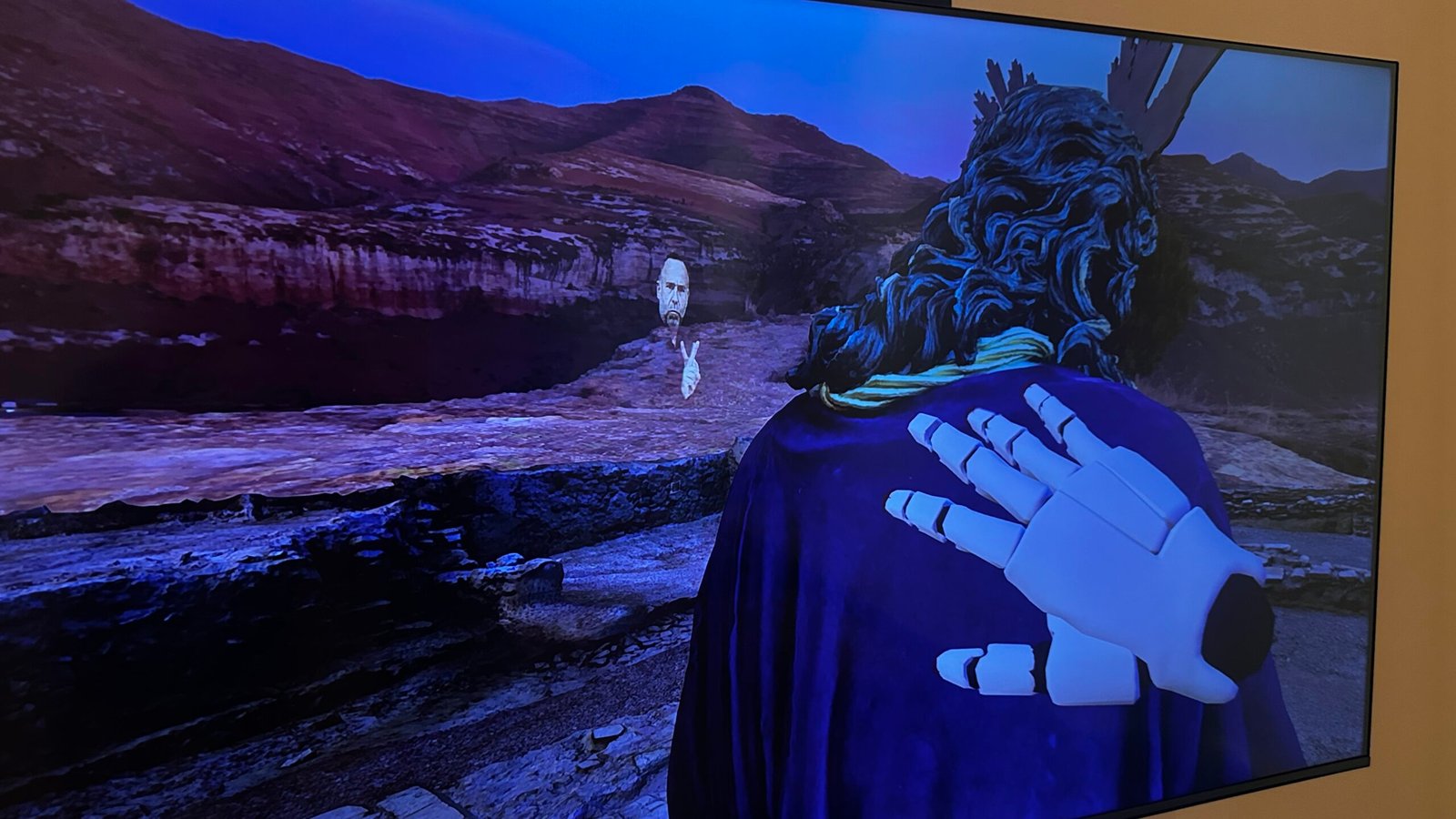

El visitante se adentra en una recreación tridimensional del patio de Caifás, escenario en el que el apóstol San Pedro niega conocer a Cristo antes de que cante el gallo. Equipado con gafas de realidad virtual HTC VIVE PRO-2 y guantes hápticos Manus Prime 3 Haptic XR conectados al Quantum Bodypack, el público puede aproximarse a las figuras digitalizadas mediante técnicas de fotogrametría y escaneado 3D, percibir sus volúmenes a través de vibraciones localizadas y escuchar un paisaje sonoro envolvente que recrea el ambiente nocturno de Jerusalén. La escena combina fidelidad arqueológica, reconstruida a partir de restos documentales del Museo Carmen Thyssen, con una poética que convierte el momento del arrepentimiento en una experiencia corporal única.

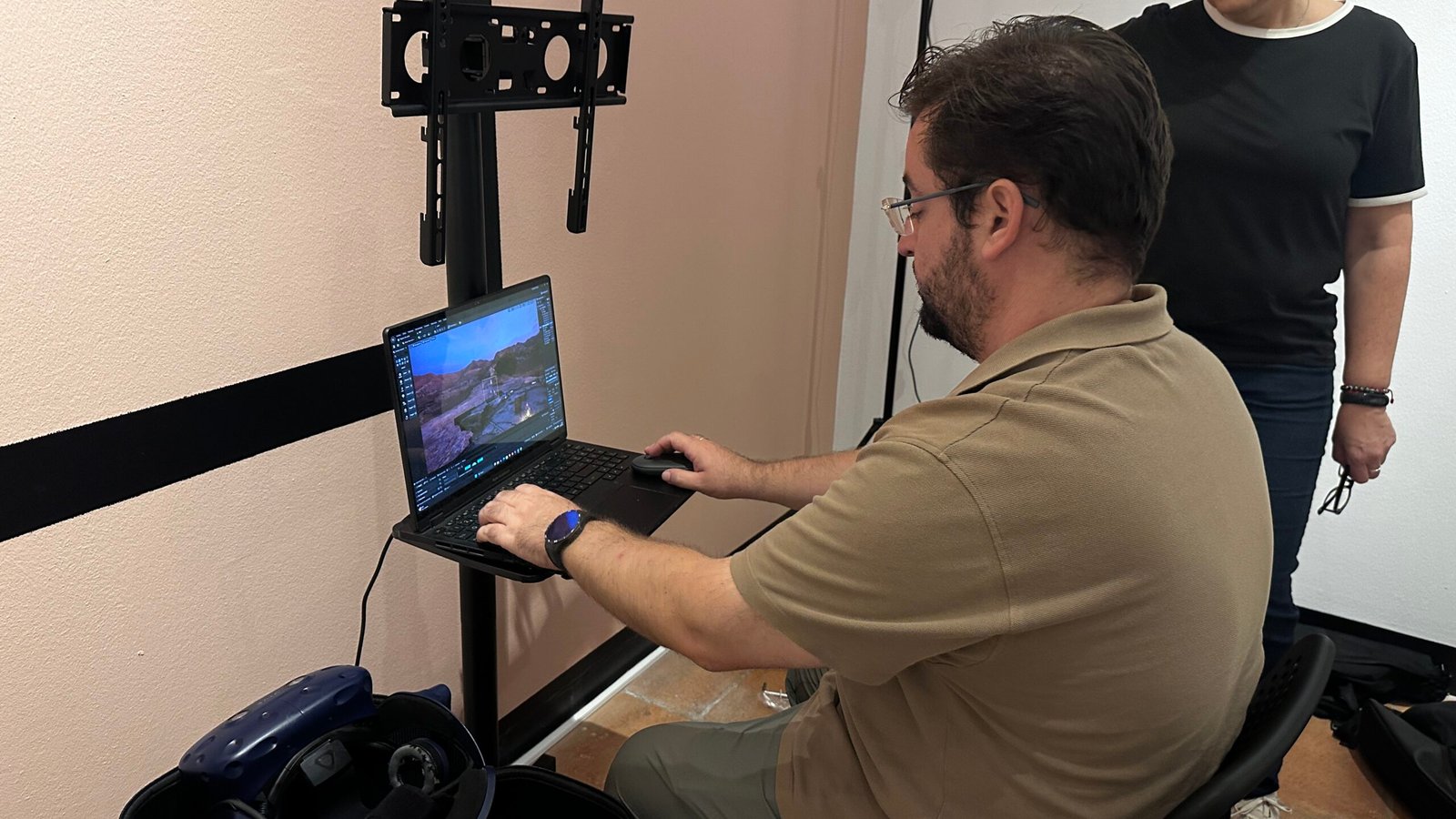

El entorno inmersivo desarrollado mediante Reality Capture y Unreal Engine 5, integra un proceso completo de limpieza, mallado, texturizado e iluminación dinámica de los modelos. Las figuras escultóricas originales de Antonio Bernal fueron capturadas con fotogrametría de alta resolución, garantizando precisión volumétrica, cromática y morfológica. La interfaz háptica, gestionada a través del sistema Manus Core, traduce los movimientos del usuario al entorno virtual, generando respuestas vibratorias diferenciadas según el personaje o el objeto tocado. Este sistema permite a las personas ciegas o con baja vibilidad reconocer las figuras mediante sensaciones táctiles sincronizadas con la narración sonora, reconstruyendo mentalmente la escena a partir de estímulos combinados.

La experiencia incorpora, además, módulos táctiles físicos impresos en 3D que reproducen fragmentos del grupo escultórico y que pueden explorarse manualmente en el resto de salas, así como estaciones olfativas y gustativas que asocian aromas y sabores simbólicos a cada personaje (esculturas originales expuestas): la piedra húmeda, el incienso, el vinagre, el metal o el frescor de la hierba de la mañana al amanecer que acompaña el canto del gallo.

Todos estos recursos amplían la percepción del visitante y consolidan el carácter verdaderamente multimodal de la propuesta que termina, precisamente, en esta experiencia tecnológica de alto impacto físico, sensorial y cognitivo.

El componente sonoro integra una banda musical reinterpretada mediante inteligencia artificial, creada con Suno AI Music software y masterizada en LANDR a partir de Lachrimae, or Seaven Teares (Lacrimae Gementes) de John Dowland (1609) realizada por una de las curadoras de la muestra. La interpretación al violín corre a cargo de Caleb Morata Ahmed, con locución de Rocío Soto Delgado e interpretación en lengua de signos de Miguel Maldonado Ruiz, conformando una narrativa multisensorial accesible que articula sonido, gesto y palabra.

La instalación ha sido desarrollada por Opossum Studios (2005) en colaboración con la Hermandad del Dulce Nombre, la Universidad de Málaga, el Ayuntamiento de Málaga, Fundación ONCE y Fundación Unicaja, entre otros. La dirección técnica y conceptual estuvo a cargo de José Gabriel Ruiz Gonzálvez (Opossum Studios) y Leticia Crespillo Marí (Universidad de Málaga), con la colaboración de Sonia Ríos Moyano y Javier González Torres, autor del guion locutado.

Desde una perspectiva científica y museológica, la experiencia se erige como un modelo replicable de museografía digital inclusiva, donde las tecnologías inmersivas (VR, háptica, sonido estéreo, impresión 3D y análisis multisensorial) convergen con la investigación en arte sacro y accesibilidad. Su aportación radica en demostrar que el patrimonio devocional puede transformarse en un laboratorio de innovación cultural, donde la tradición escultórica se funde con la experimentación tecnológica para generar conocimiento, emoción y participación ciudadana en igualdad de condiciones.